Η Anthropic αρνείται να επιτρέψει τη χρήση των εργαλείων τεχνητής νοημοσύνης της για μαζική παρακολούθηση ή πλήρως αυτόνομα όπλα, παρά τις απαιτήσεις του Πενταγώνου.

Η Anthropic αρνείται να επιτρέψει τη χρήση των εργαλείων τεχνητής νοημοσύνης της για μαζική παρακολούθηση ή πλήρως αυτόνομα όπλα, παρά τις απαιτήσεις του Πενταγώνου.

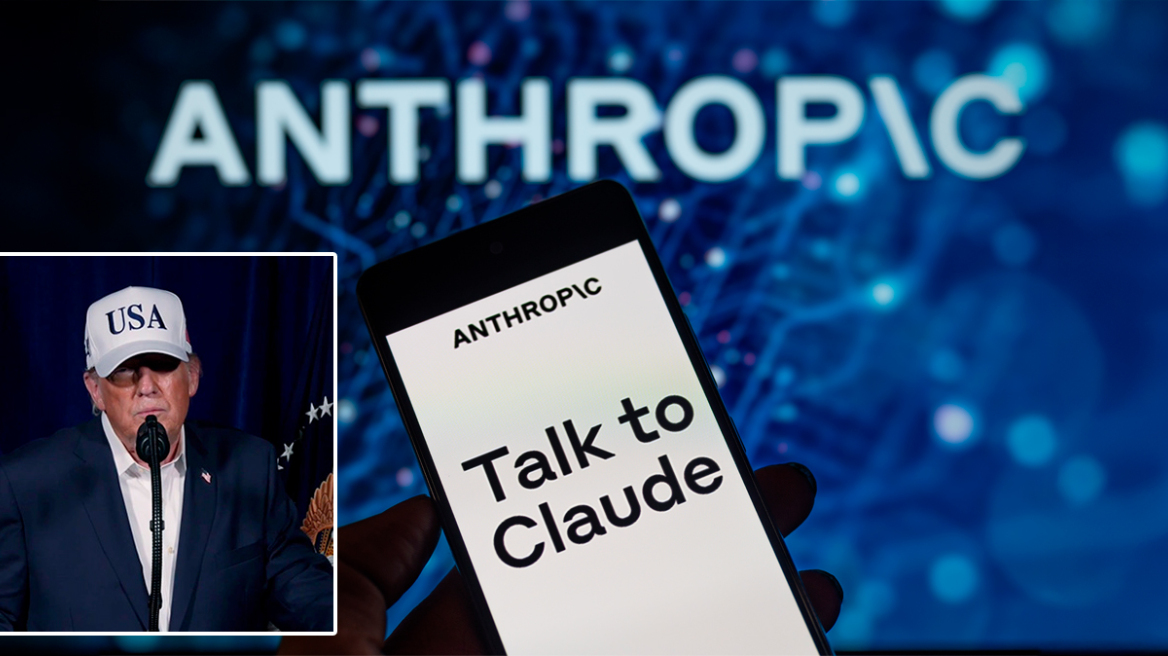

Ο Ντόναλντ Τραμπ διέταξε την άμεση διακοπή της τεχνολογίας Claude σε όλες τις ομοσπονδιακές υπηρεσίες, δίνοντας έξι μήνες για απόσυρση.

Το Πεντάγωνο επιμένει ότι οι εργολάβοι δεν μπορούν να υπαγορεύουν τη χρήση των εργαλείων AI όταν αυτά αποκτώνται νόμιμα, ενώ η Anthropic θέτει όρια ασφαλείας.

Η αντιπαράθεση αφορά τον έλεγχο της χρήσης της τεχνητής νοημοσύνης σε στρατιωτικές εφαρμογές υψηλού ρίσκου και όχι μόνο σε βοηθητικά εργαλεία.

Εργαζόμενοι σε εταιρείες AI και πολιτικοί εκφράζουν ανησυχίες για την εθνική ασφάλεια και τις ηθικές προεκτάσεις της χρήσης της τεχνολογίας. Η αντιπαράθεση ανάμεσα στον Ντόναλντ Τραμπ και την Anthropic δεν είναι απλώς μια διαφωνία για ένα συμβόλαιο. Στην καρδιά της διαμάχης βρίσκεται το ποιος αποφασίζει για τη χρήση της τεχνητής νοημοσύνης στον πόλεμο και στην ασφάλεια. Το Πεντάγωνο επιμένει σε απεριόριστη πρόσβαση και χρήση των εργαλείων AI όπως κρίνει εκείνο, ενώ η Anthropic αρνείται να παραβιάσει τις αρχές ασφάλειας που έχει θέσει για τα προϊόντα της.

Ουσιαστικά, το ερώτημα είναι σαφές: μπορεί μια ιδιωτική εταιρεία AI να αρνηθεί τη χρήση των συστημάτων της για πλήρως αυτόνομα όπλα ή μαζική παρακολούθηση εντός των ΗΠΑ, ακόμη κι αν η κυβέρνηση θεωρεί τη χρήση αυτή νόμιμη;

Anthropic vs Πεντάγωνο: Το κρίσιμο σημείο Η Anthropic, ιδρυθείσα από τον πρώην επικεφαλής έρευνας της OpenAI, Dario Amodei, έχει καθιερώσει τη φήμη της ως εργαστήριο AI με προτεραιότητα την ασφάλεια. Το κύριο προϊόν της, Claude, χρησιμοποιείται ήδη σε εθνικά συστήματα ασφαλείας, ακόμα και σε διαβαθμισμένα δίκτυα.

Η εταιρεία έχει κερδίσει μέχρι και 200 εκατ. δολάρια σε συμβάσεις με το Πεντάγωνο το προηγούμενο έτος, με τα εργαλεία της να χρησιμοποιούνται για ανάλυση πληροφοριών, επιχειρησιακό σχεδιασμό και κυβερνοεπιχειρήσεις.

Ωστόσο, η Anthropic έχει ενσωματώσει αυστηρά όρια ασφαλείας. Όπως δηλώνει ο Amodei, η AI δεν θα χρησιμοποιηθεί για:

Μαζική παρακολούθηση των πολιτών των ΗΠΑ και πλήρως αυτόνομα θανατηφόρα όπλα.

Η εταιρεία θεωρεί ότι τέτοιες χρήσεις είτε υπονομεύουν τις δημοκρατικές αξίες είτε υπερβαίνουν τις τρέχουσες δυνατότητες της AI. Το Πεντάγωνο διαφωνεί, υποστηρίζοντας ότι οι εργολάβοι δεν μπορούν να υπαγορεύουν πώς χρησιμοποιούνται τα εργαλεία όταν αποκτώνται νόμιμα.

Η άρνηση της Anthropic να δεχθεί τη χρήση «κάθε νόμιμης χρήσης» οδήγησε τον Τραμπ να διατάξει την άμεση διακοπή της τεχνολογίας Claude σε όλες τις ομοσπονδιακές υπηρεσίες. Παράλληλα, ορίστηκε μια φάση έξι μηνών για απόσυρση, ενώ το Πεντάγωνο σχεδιάζει να χαρακτηρίσει την εταιρεία «κίνδυνο στην αλυσίδα εφοδιασμού», έναν χαρακτηρισμό που συνήθως εφαρμόζεται σε ξένους αντιπάλους. Οι νομικοί περιέγραψαν την κίνηση αυτή ως το «συμβατικό ισοδύναμο πυρηνικού πολέμου».

Η στρατηγική του Πενταγώνου Το Πεντάγωνο ζητούσε από την Anthropic να συμφωνήσει σε «οποιαδήποτε νόμιμη χρήση» της AI. Η εταιρεία ζήτησε δύο σαφείς εξαιρέσεις:

Καμία χρήση για μαζική παρακολούθηση πολιτών

Καμία χρήση σε πλήρως αυτόνομα θανατηφόρα όπλα

Οι υπεύθυνοι του Πενταγώνου δήλωσαν ότι δεν ενδιαφέρονται για αυτές τις εφαρμογές, αλλά δεν δέχθηκαν συμβατικούς περιορισμούς. Η ένταση αυτή δείχνει επίσης μια ευρύτερη αλλαγή στον τρόπο που χρησιμοποιείται η τεχνητή νοημοσύνη: πλέον δεν περιορίζεται μόνο σε chatbots (ψηφιακούς βοηθούς) ή βοηθητικά εργαλεία για προγραμματισμό, αλλά επεκτείνεται σε εφαρμογές υψηλού ρίσκου, όπως η διαχείριση και οργάνωση στρατιωτικών επιχειρήσεων στο πεδίο της μάχης, τα συστήματα στόχευσης και οι πλατφόρμες που συνδυάζουν και αναλύουν πληροφορίες για στρατηγικές αποφάσεις.

Οι οργανώσεις ανθρωπίνων δικαιωμάτων έχουν προειδοποιήσει εδώ και χρόνια για τα λεγόμενα «δολοφονικά ρομπότ» – συστήματα που επιλέγουν και πλήττουν στόχους χωρίς ανθρώπινη εποπτεία. Παρά το γεγονός ότι μερικώς αυτόνομα συστήματα χρησιμοποιούνται ήδη σε συγκρούσεις όπως στην Ουκρανία και τη Γάζα, τα πλήρως αυτόνομα θανατηφόρα όπλα παραμένουν αμφιλεγόμενα.

Η Anthropic υποστηρίζει ότι τα σύγχρονα μοντέλα AI δεν είναι αρκετά αξιόπιστα για τέτοιους ρόλους. Το Πεντάγωνο, αντίθετα, θεωρεί ότι αυτοί που καθορίζουν την αποδεκτή στρατιωτική πρακτική είναι οι στρατιωτικοί και όχι η Silicon Valley.

OpenAI και Έλον Μασκ, ως εναλλακτικές λύσεις Η κυβέρνηση Τραμπ πλησίασε την OpenAI για να καλύψει το κενό που αφήνει η Anthropic. Η αντιπαλότητα μεταξύ Anthropic και OpenAI ξεκινά από το 2021, όταν ο Amodei και άλλοι ερευνητές εγκατέλειψαν την OpenAI λόγω «διαφορετικών κατευθύνσεων», κυρίως γύρω από την ασφάλεια και την ευθυγράμμιση.

Ωστόσο, η OpenAI του Sam Altman έχει δηλώσει επίσης ότι δεν υποστηρίζει μαζική παρακολούθηση ή πλήρως αυτόνομα όπλα. Ο Altman τόνισε ότι οι άνθρωποι πρέπει να έχουν τον έλεγχο για κρίσιμες αποφάσεις, ενώ η εταιρεία θα προσπαθήσει να εφαρμόσει όρια παρόμοια με της Anthropic.

Υπάρχει επίσης η πιθανότητα ο Έλον Μασκ να παρέμβει με το AI μοντέλο Grok, επιδιώκοντας συμβάσεις εθνικής ασφάλειας και προσθέτοντας νέα πολιτική διάσταση στη «κούρσα της τεχνητής νοημοσύνης».

Πολιτικές και ιδεολογικές προεκτάσεις

Ο Τραμπ κατηγορεί την Anthropic ότι προσπαθεί να «υποχρεώσει» το Πεντάγωνο και ότι θέτει σε κίνδυνο τους Αμερικανούς στρατιώτες. Ορισμένοι πολιτικοί, όπως ο Δημοκρατικός γερουσιαστής Mark Warner, προειδοποιούν ότι οι αποφάσεις για την εθνική ασφάλεια δεν πρέπει να καθορίζονται από πολιτικές σκοπιμότητες.

Στο μεταξύ, εκατοντάδες εργαζόμενοι της OpenAI και της Google DeepMind υπέγραψαν επιστολή καλώντας τις εταιρείες AI να μην υποκύψουν σε πίεση από το Πεντάγωνο, επικαλούμενοι προβλήματα μαζικής παρακολούθησης και πλήρως αυτόνομων όπλων.

Οικονομικές και λειτουργικές συνέπειες

Για την Anthropic, η οικονομική ζημία είναι άμεση: τα κρατικά συμβόλαια και οι εφαρμογές σε εθνικά συστήματα ασφαλείας αποτελούν βασικό μέρος της στρατηγικής ανάπτυξής της, ειδικά εν όψει πιθανής εισαγωγής στο χρηματιστήριο.

Για την κυβέρνηση, η έξοδος της τεχνολογίας Claude μπορεί να διαταράξει συστήματα σχεδιασμού, ανάλυσης και κυβερνοασφάλειας. Η αντικατάσταση μοντέλων δεν είναι απλή, απαιτεί εκπαίδευση συστημάτων, μεταφορά δεδομένων και επικύρωση διαβαθμισμένων πληροφοριών. Η κυβέρνηση των ΗΠΑ έδωσε έξι μήνες στην Anthropic για να αποσύρει σταδιακά την τεχνολογία της από όλες τις ομοσπονδιακές υπηρεσίες. Το χρονικό διάστημα ίσως είναι πολύ σύντομο ή δύσκολος να τηρηθεί, δηλαδή μπορεί να μην είναι αρκετό για να ολοκληρωθεί με ασφάλεια η διαδικασία χωρίς προβλήματα.

Το μέλλον της AI στον πόλεμο και τη μαζική παρακολούθηση

Η απόσταση μεταξύ εργαστηριακής έρευνας και στρατιωτικής εφαρμογής συρρικνώνεται συνεχώς. Το ζήτημα των «δολοφονικών ρομπότ» και της μαζικής παρακολούθησης δεν πρόκειται να λυθεί με ένα μόνο συμβόλαιο.

Το μήνυμα της Ουάσινγκτον είναι σαφές: στην ασφάλεια και στον πόλεμο, αποφασίζει το κράτος. Η Anthropic, όμως, ξεκαθαρίζει ότι όχι κάθε νόμιμη χρήση είναι ασφαλής χρήση. Η αντιπαράθεση αυτή αποτελεί πλέον το επίκεντρο μιας ευρύτερης συζήτησης για την ηθική, την ασφάλεια και τον έλεγχο της AI σε παγκόσμιο επίπεδο.

Δεν υπάρχουν σχόλια:

Δημοσίευση σχολίου